はじめに

自治体でも、文書作成、議事録要約、庁内FAQ、住民問い合わせ対応などで生成AIの活用が現実的なテーマになっています。

しかし、個人情報を扱う自治体業務では、「便利だから使う」という発想だけでは不十分です。

特に自治体は、住民の氏名、住所、家族構成、税、福祉、健康、相談履歴など、慎重に扱うべき情報を多く保有しています。生成AIの導入では、業務効率化と同時に、個人情報保護、情報セキュリティ、説明責任、職員の利用ルールを一体で設計する必要があります。

デジタル庁は、政府における生成AIの利活用促進とリスク管理を表裏一体で進めるため、「行政の進化と革新のための生成AIの調達・利活用に係るガイドライン」を決定しています。 また、同ガイドラインはデジタル社会推進標準ガイドライン群のDS-920として位置づけられ、政府における生成AIのガバナンスや調達・利活用時のルールを定めるものとされています。

本記事では、アップロード資料「個人情報を扱う自治体業務における生成AI利活用ガバナンスと実施基準に関する包括的調査報告」をもとに、自治体が生成AIを安全に活用するための考え方を整理します。

自治体の生成AI活用は「効率化」だけでは判断できない

生成AIは、自治体業務の負担軽減に大きな可能性があります。

たとえば、会議録の要約、通知文の下書き、FAQ案の作成、制度説明文の整理、庁内資料のたたき台づくりなどは、比較的導入しやすい領域です。

一方で、自治体業務には住民の権利や生活に直接関わる判断が含まれます。AIの出力をそのまま使えば、誤情報、偏り、説明不足、個人情報の不適切な取扱いにつながる可能性があります。

つまり、自治体における生成AI活用の本質は、単なる業務効率化ではありません。

「どの業務で使えるのか」「どの情報は入力してはいけないのか」「誰が確認するのか」「問題が起きたときに誰が責任を持つのか」を決める、ガバナンス設計そのものです。

個人情報を扱う自治体業務でまず確認すべきこと

個人情報保護法では、行政機関等が守るべき個人情報の取扱いとして、保有の制限、利用目的の明示、不適正な利用・取得の禁止、正確性の確保、安全管理措置、利用・提供の制限などが定められています。

この考え方を生成AIに当てはめると、最初に確認すべきことは明確です。

生成AIに入力する必要が本当にあるか

個人情報を含む情報を生成AIに入力する前に、その入力が業務目的の達成に本当に必要かを確認する必要があります。

たとえば、文書の表現を整えるだけなら、氏名、住所、生年月日、相談内容などを入れなくても処理できる場合があります。

自治体業務では、「便利だからそのまま貼り付ける」のではなく、匿名化、要約、仮名化、不要項目の削除などを行ったうえで利用できないかを先に検討すべきです。

入力データが学習に使われない環境か

個人情報保護委員会は、生成AIサービスの普及を踏まえ、生成AIサービスの利用に関する注意喚起を行っています。

自治体が利用する場合は、入力した情報がAIモデルの学習に利用されないこと、サービス提供者側で目的外利用されないこと、保存期間や管理方法が明確であることを確認する必要があります。

特に、無料または一般向けの標準規約サービスは、自治体業務で扱う情報を入力する環境として適切でない場合があります。業務で使うなら、契約条件、データの保存場所、監査性、アクセス制御、ログ管理を確認できる専用環境が望まれます。

要配慮個人情報を扱わない設計にする

福祉、医療、障害、相談、家庭状況、生活困窮、犯罪被害、税情報などは、住民の権利利益に大きく関わる情報です。

こうした情報を生成AIで扱う場合は、単に「個人名を消せばよい」という話ではありません。内容そのものから個人が推測される可能性もあります。

そのため、自治体は「入力してよい情報」と「入力してはいけない情報」を、職員が迷わず判断できる形で明文化する必要があります。

情報資産分類に応じて生成AIの利用範囲を分ける

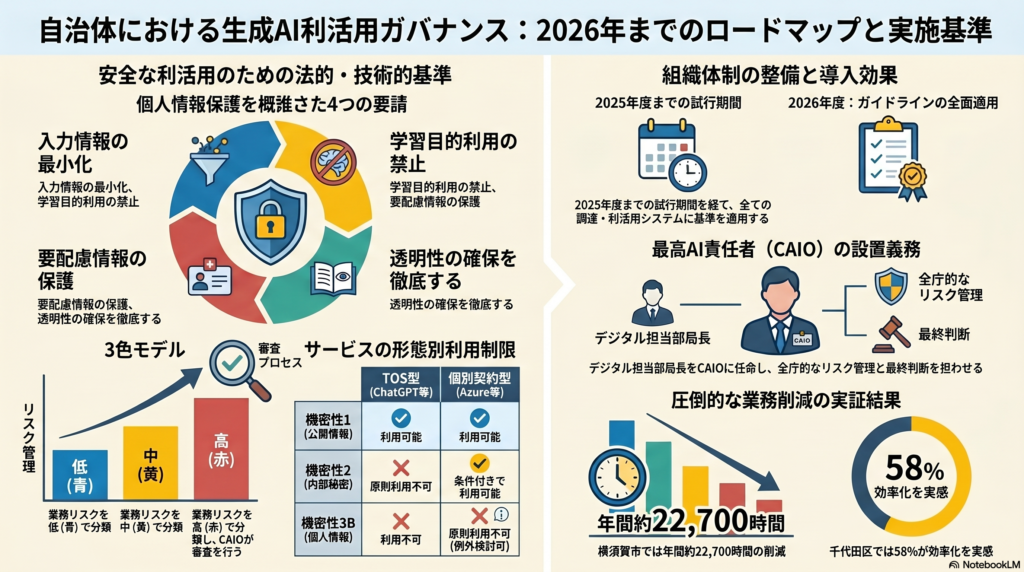

自治体が生成AIを導入する際は、情報を一律に扱うのではなく、情報資産の機密性に応じて利用可否を分けることが重要です。

アップロード資料では、公開情報、内部情報、機密情報、個人情報などの分類に応じて、標準規約型サービスと専用クラウド環境の利用可否を分ける考え方が示されています。

たとえば、公開済みの広報文、イベント案内、一般的な制度説明であれば、生成AIを使いやすい領域です。

一方で、未公開の政策資料、庁内の意思決定資料、住民相談記録、福祉・税・医療に関する情報は、慎重な管理が必要です。

自治体に必要なのは、「AI利用を全面禁止すること」ではありません。

情報の性質に応じて、使える範囲を分けることです。

自治体に必要な生成AIガバナンス体制

生成AIは、職員一人ひとりの判断だけに任せると、使い方が部署ごとにばらつきます。

その結果、ある部署では便利に使われ、別の部署では禁止され、さらに別の部署ではリスクを理解しないまま使われるという状態になりかねません。

政府の生成AIガイドライン改定案では、各府省庁にAI統括責任者、いわゆるCAIOを設置し、生成AIシステムの企画、行政データの取扱い、調達、利活用、運用、リスク状況を一元的に把握する体制が示されています。

自治体においても、同じ発想が必要です。

名称はCAIOでなくても構いません。重要なのは、生成AIの利用ルール、調達基準、リスク判断、職員研修、インシデント対応を横断的に見る責任者またはチームを置くことです。

生成AI利用ルールに入れるべき項目

自治体の生成AI利用ルールには、少なくとも次の項目を含める必要があります。

- 利用できる業務と利用できない業務

- 入力してよい情報と禁止する情報

- 個人情報を扱う場合の匿名化・削除ルール

- 出力結果の確認責任

- ハルシネーション対策

- 著作権・肖像権・差別表現への注意

- ログ管理と利用状況の確認

- 問題発生時の報告先

- 職員研修の実施方法

政府ガイドライン改定案でも、生成AIシステムの利活用ルールには、利用前に理解すべき知識、要機密情報の取扱い、利用目的の範囲、AI生成物の取扱い、知的財産権への対策、リスクケース発生時の報告などを含める考え方が示されています。

ハルシネーション対策は「人間の確認」が前提

生成AIの大きなリスクの一つが、事実と異なる内容を自然な文章で出力するハルシネーションです。

政府ガイドライン改定案でも、生成AIが事実と異なる情報を出力し、それを利用したことで第三者に不利益を与えるケースがリスクとして挙げられています。

自治体業務では、制度説明、申請案内、給付要件、手続期限などの誤りが、住民の不利益につながる可能性があります。

そのため、生成AIの出力は「完成文」ではなく「たたき台」として扱うべきです。

特に住民向け文書では、根拠となる法令、条例、要綱、公式ページ、庁内文書を人間が確認する体制が欠かせません。

RAG活用では検索先データの管理が重要になる

今後、自治体で注目されるのが、庁内文書やFAQを検索対象にして回答を生成するRAGの活用です。

RAGを使えば、一般的な生成AIよりも庁内情報に基づいた回答を作りやすくなります。

ただし、RAGの検索先に個人情報や非公開情報が含まれている場合、権限のない職員に情報が表示されたり、不適切な個人情報が回答に混ざったりするリスクがあります。政府ガイドライン改定案でも、RAGの検索先に個人に関する情報が含まれる場合、不適切な個人情報の出力を制御する仕組みが必要とされています。

つまり、RAG導入では「AIの性能」だけでなく、「どの文書を読み込ませるか」「誰が検索できるか」「回答に出してよい情報は何か」を設計することが重要です。

AIエージェント時代に向けた自治体の課題

生成AIは、単に文章を作るツールから、複数の作業を自律的に進めるAIエージェントへと進化しつつあります。

デジタル庁の先進的AI利活用アドバイザリーボードでも、今後ガイドラインを生成AIに読み込ませて活用するケースや、AIエージェントのガバナンスが論点として扱われています。

自治体にとって、これは大きな転換点です。

今は「職員がAIに質問する」段階でも、将来的には「AIが複数の庁内資料を参照し、申請内容を確認し、回答案を作成する」ような使い方が現実味を帯びてきます。

だからこそ、今の段階で入力ルール、承認ルール、ログ管理、責任分担を整えておくことが重要です。

まとめ

自治体における生成AI活用は、避けるべきものではありません。

むしろ、人口減少、人手不足、業務量の増加が進む中で、行政サービスを維持するための有効な選択肢になり得ます。

ただし、個人情報を扱う自治体業務では、便利さだけを優先してはいけません。

必要なのは、情報資産分類に応じた利用範囲の設定、個人情報を入力しない運用、専用環境の確認、職員研修、出力確認、責任者の設置、インシデント対応まで含めたガバナンスです。

生成AIは、自治体職員の仕事を奪うものではなく、適切に使えば職員の判断と住民サービスを支える道具になります。

そのためには、「使うか使わないか」ではなく、「安全に使える仕組みをどう作るか」という視点が欠かせません。

コメント