はじめに

自治体における生成AI活用は、すでに「試してみる段階」から「どう安全に使いこなすか」という段階へ移りつつあります。

文書作成、議事録要約、庁内FAQ、住民向け説明文の下書き、企画案の整理など、生成AIは行政実務のさまざまな場面で活用できる可能性があります。一方で、自治体が扱う情報には、個人情報、未公開の政策情報、契約情報、住民対応に関する記録など、外部に出してはならないものが多く含まれます。

そのため、自治体の生成AI導入では、単に便利なツールを入れるだけでは不十分です。重要なのは、職員が「何に使ってよいのか」「何を入力してはいけないのか」「出力結果をどう確認すべきか」を理解し、組織として安全に運用できる状態をつくることです。

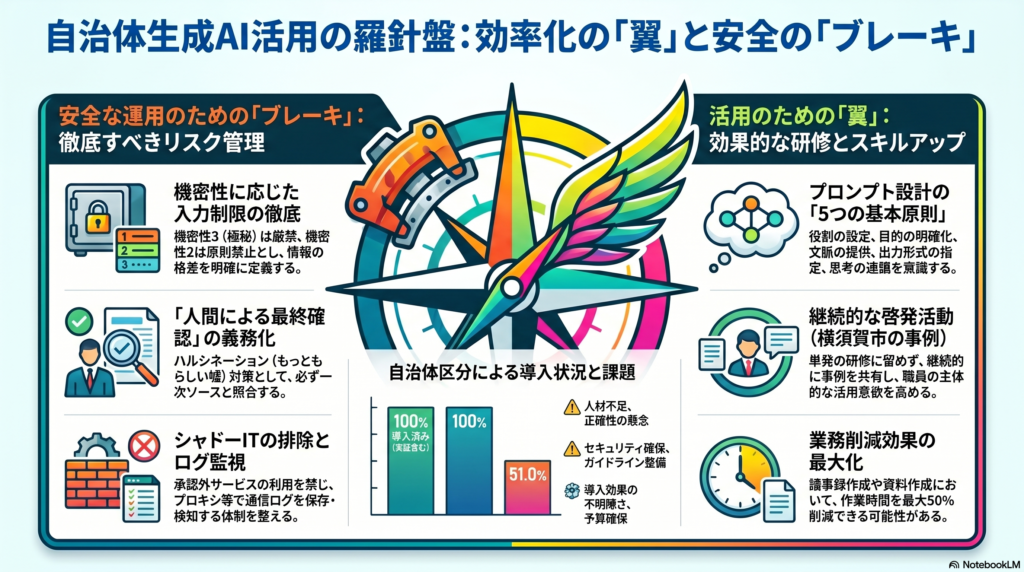

総務省の調査をもとにした分析では、2024年12月末時点でAI・RPAを導入済みの地方自治体は1,154団体に達し、AIについては都道府県と政令指定都市で導入率100%、その他の市区町村でも約58%まで広がっています。一方で、自治体の課題として「人材不足」「予算獲得の難しさ」「導入効果が不明」といった点も示されています。

生成AIは、自治体業務の効率化を支える有力な手段になり得ます。しかし、正しく使うための研修とルールがなければ、情報漏えいや誤情報の拡散、著作権侵害、住民からの信頼低下につながるおそれもあります。

本記事では、自治体が生成AIを導入する際に職員研修で押さえるべきポイントと、リスク管理の考え方を整理します。

自治体で生成AI活用が進む背景

自治体では、人口減少、少子高齢化、職員数の制約、住民ニーズの多様化などにより、業務負担が年々大きくなっています。

問い合わせ対応、議事録作成、報告書作成、庁内照会、広報文作成、制度改正への対応など、行政現場には多くの文書業務があります。これらの業務は重要である一方、職員の時間を大きく使いやすい領域でもあります。

生成AIは、こうした業務の「たたき台作成」「要約」「整理」「言い換え」「構成案づくり」を支援できます。たとえば、会議メモから議事録案を作る、住民向けのお知らせ文をわかりやすく整える、複雑な制度説明を職員向けに要約する、といった使い方が考えられます。

横須賀市では、2023年4月からChatGPTの全庁的な活用実証を行い、その後、本格実装や職員のスキルアップに向けた取り組みを進めています。同市はプロンプトコンテストやノウハウ共有にも取り組み、自治体における生成AI活用の先進事例の一つとして注目されています。

ただし、先進事例から学ぶべき点は「生成AIを導入したこと」だけではありません。むしろ重要なのは、導入後に職員の理解を深め、実務に合わせた使い方を育て、組織として安全に利用する仕組みを整えている点です。

生成AI導入は、システム導入ではなく、業務の進め方を見直す取り組みです。だからこそ、職員研修が成否を分けます。

職員研修で最初に伝えるべきこと

自治体の生成AI研修でまず伝えるべきなのは、生成AIは「答えを保証する機械」ではなく、「業務を支援する道具」だということです。

生成AIは自然な文章を作ることが得意ですが、出力内容が常に正しいとは限りません。存在しない制度や根拠をそれらしく書いたり、古い情報をもとに回答したり、文脈に合わない表現を出したりすることがあります。

そのため、職員研修では、便利な使い方だけでなく、次のような基本姿勢を徹底する必要があります。

- 生成AIの出力は必ず人間が確認する

- 住民への回答や公開資料にそのまま使わない

- 個人情報や機密情報を入力しない

- 判断の責任はAIではなく職員と組織にある

- 利用できる環境と利用してはいけない環境を分ける

デジタル庁も、生成AIの利活用促進とリスク管理を表裏一体で進める考え方を示しており、政府におけるAIガバナンスやベストプラクティス、リスクへの考え方を整理しています。

自治体でも同じです。生成AIを止めるのではなく、安全に使える範囲を明確にし、職員が安心して活用できる状態をつくることが大切です。

情報漏えいを防ぐための入力ルール

自治体職員の生成AI利用で、最も注意すべきリスクの一つが情報漏えいです。

生成AIに入力した内容が、サービスの仕様や設定によっては学習や改善に利用される可能性があります。特に、一般公開型の外部AIサービスを業務で使う場合、入力内容の取り扱いを十分に確認しなければなりません。

職員研修では、入力してよい情報と入力してはいけない情報を、抽象論ではなく具体例で示すことが重要です。

入力してはいけない情報の例

- 氏名、住所、電話番号、メールアドレスなどの個人情報

- マイナンバーや健康情報など、特に慎重な管理が必要な情報

- 未公開の政策案、議会資料、契約書案、入札関連情報

- 住民相談や苦情対応の具体的な記録

- 人事評価、職員情報、内部調整中の文書

- 外部に公開されていない庁内資料

一方で、すでに公開されている広報文、統計情報、一般的な制度説明、個人が特定されないサンプル文などは、条件を整えれば活用できる場合があります。

ただし、ここで大切なのは「公開情報だから何でもよい」と考えないことです。公開情報であっても、出典確認や内容確認は必要です。また、複数の情報を組み合わせることで個人や内部事情が推測できる場合もあります。

そのため、自治体では「入力禁止情報リスト」「利用可能な業務例」「承認が必要な利用例」を整理し、職員が迷わず判断できるようにする必要があります。

ハルシネーション対策は必須の研修項目

生成AIの大きなリスクとして、ハルシネーションがあります。

ハルシネーションとは、生成AIが事実と異なる内容を、もっともらしい文章として出力してしまう現象です。自治体業務では、制度、条例、補助金、税、福祉、教育、防災など、正確性が求められる分野が多くあります。誤った情報を住民に伝えれば、行政への信頼を損なう可能性があります。

特に注意すべきなのは、生成AIの文章が非常に自然であるため、誤りに気づきにくいことです。見た目が整っているから正しい、という判断は危険です。

職員研修では、次の確認手順を徹底する必要があります。

1. 一次情報を確認する

条例、規則、国の通知、自治体公式ページ、所管課の資料など、根拠となる一次情報を確認します。生成AIの回答だけを根拠にしてはいけません。

2. 数字・日付・固有名詞を確認する

制度名、担当部署名、金額、対象者、申請期限、施行日などは誤りが生じやすい項目です。公開前に必ず確認する必要があります。

3. 住民向け文書では表現を調整する

生成AIの文案は、行政文書として硬すぎたり、逆に軽すぎたりすることがあります。住民に誤解を与えない表現に整えることが必要です。

4. 最終判断は人間が行う

生成AIは判断者ではありません。あくまで下書きや整理の補助です。最終的な責任は、職員と組織にあります。

この「人間による最終確認」を業務プロセスに組み込むことが、自治体の生成AI活用では欠かせません。

著作権・知的財産への配慮

生成AIを使って文章や画像を作成する場合、著作権への配慮も必要です。

たとえば、既存の文章をそのまま入力して要約させる、特定の作家やイラストレーターの作風を指定して生成する、既存画像をもとに似た画像を作る、といった使い方には注意が必要です。

自治体が広報物、チラシ、ウェブサイト、SNS投稿などにAI生成物を使う場合、権利侵害のリスクを避けるために、次の点を確認することが重要です。

- 既存の著作物に過度に類似していないか

- 特定の作家名や作品名を指定していないか

- 画像生成に元画像を使う場合、利用許諾があるか

- AI生成物を公開利用してよいサービス規約か

- 生成過程や使用したプロンプトを記録しているか

文化庁は、AIと著作権に関する考え方の整理を進めており、生成AIの利用においても著作権法上の論点が生じ得ることが示されています。自治体では、広報・観光・教育・文化関連の業務でAI生成物を使う場面が想定されるため、著作権リスクを研修に含めることが望まれます。

生成AIを使った制作物は、便利だからこそ確認が必要です。特に自治体の発信は公的な情報として受け止められるため、「知らなかった」では済まされない場面があります。

バイアスと倫理的リスクにも注意する

生成AIは、インターネット上の膨大なデータをもとに学習しています。そのため、出力内容に偏見や固定観念が含まれる可能性があります。

たとえば、性別、年齢、国籍、障がい、地域、職業、家族構成などに関する表現で、無意識の偏りが出ることがあります。自治体は公平性・中立性が強く求められる組織です。生成AIの出力をそのまま使うことで、特定の住民を不利益に扱うような表現になっていないか、慎重に確認する必要があります。

職員研修では、次の視点を持つことが大切です。

- 特定の属性に対する決めつけがないか

- 住民に不安や誤解を与える表現がないか

- 行政として中立的な表現になっているか

- 弱い立場にある人への配慮があるか

- 住民サービスの公平性を損なっていないか

生成AIの活用は、効率化だけを目的にしてはいけません。行政としての信頼、公平性、説明責任を守ることが前提です。

プロンプト設計は「業務品質」を左右する

生成AIを安全かつ効果的に使うには、プロンプト設計の基本を職員が理解することも重要です。

プロンプトとは、生成AIに対する指示文のことです。同じテーマでも、指示の出し方によって出力の品質は大きく変わります。

たとえば、「説明文を書いて」だけでは、対象者、目的、文体、文字数、前提条件が不明確です。一方で、次のように条件を整理すると、実務で使いやすい回答に近づきます。

あなたは自治体の広報担当職員です。

高齢者向けに、住民健診の予約方法をわかりやすく説明する文章を作成してください。

文字数は600字以内。専門用語を避け、やさしい表現にしてください。

最後に、問い合わせ先を記載する欄を残してください。

宇都宮市の生成AI活用ガイドラインでも、役割を明確にすることや、対象者を具体化することで、行政に必要な情報を得やすくなるという考え方が示されています。

自治体の職員研修では、単に「便利なプロンプト集」を配るだけでなく、自分の業務に合わせて指示を組み立てる練習が必要です。

プロンプト設計で意識したいポイントは、次の5つです。

- 役割を指定する

例:「あなたは自治体の広報担当者です」 - 対象者を明確にする

例:「高齢者向け」「子育て世帯向け」「新人職員向け」 - 目的を伝える

例:「制度をわかりやすく説明する」「会議資料の構成を作る」 - 条件を示す

例:「800字以内」「箇条書き」「専門用語を避ける」 - 確認を前提にする

例:「根拠が不明な点は推測せず、不明と書いてください」

プロンプト設計は、生成AIを使うための小手先の技術ではありません。業務の目的を整理し、必要な情報を明確にする訓練でもあります。

職員研修は一度きりではなく継続型にする

生成AI研修は、一度実施して終わりにするべきではありません。

生成AIの技術は変化が速く、利用できるサービス、機能、リスク、関連ルールも更新されていきます。デジタル庁も、生成AI技術の発展や政府におけるユースケースの広がり、各種リスク対策の必要性を踏まえ、ガイドラインを充実させるための改定を進めています。

自治体でも、導入初期の研修だけでなく、次のような継続的な取り組みが必要です。

- 初任者向けの基礎研修

- 管理職向けのリスク管理研修

- 所管課別の実務活用ワークショップ

- プロンプト共有会

- 失敗事例・ヒヤリハットの共有

- ガイドライン改定時の再研修

- 利用状況や効果の定期的な確認

特に重要なのは、職員が「使ってはいけない」と萎縮するのではなく、「安全な範囲で使ってよい」と理解できる環境をつくることです。

生成AIの活用を広げるには、禁止事項を伝えるだけでは不十分です。具体的な業務でどう使えるのか、どこまでなら安全なのか、どの段階で上司や所管部署に確認するのかを明確にする必要があります。

自治体が整えるべき組織体制

生成AIの安全な活用には、職員個人の注意だけでなく、組織としての体制整備が欠かせません。

具体的には、次のような役割分担が必要です。

情報政策・DX担当部門

生成AIの導入方針、利用ツールの選定、庁内ルールの整備、職員研修の企画を担います。

情報セキュリティ担当部門

入力禁止情報、ログ管理、アクセス権限、外部サービス利用時の確認など、情報管理の観点からルールを整えます。

法務・文書管理担当部門

著作権、個人情報保護、行政文書管理、説明責任に関する観点から利用基準を確認します。

各業務所管課

実際の業務における活用場面を整理し、使える業務と慎重に扱うべき業務を判断します。

管理職

部下の利用状況を把握し、リスクのある使い方を防ぐとともに、効果的な活用を後押しします。

生成AIは、一部の詳しい職員だけが使うものではありません。全庁的に活用するのであれば、全庁的に支える仕組みが必要です。

生成AI導入で避けたい失敗

自治体が生成AIを導入する際に避けたいのは、「ツールを入れたが使われない」または「使われているが統制できていない」という状態です。

前者は、研修不足や業務との接続不足によって起こります。職員が「自分の仕事にどう役立つのか」を理解できなければ、生成AIは一部の人だけが使う道具になります。

後者は、ルール不足や管理不足によって起こります。便利だからといって個人アカウントや未承認の外部サービスを使えば、シャドーIT化し、ログ管理や事後検証が難しくなります。

自治体の生成AI導入では、次のような失敗を避ける必要があります。

- 利用ルールを作らずに導入する

- 禁止事項だけを並べて活用が進まない

- 職員研修を一度だけで終える

- 個人情報や機密情報の判断を現場任せにする

- 出力結果の確認責任を曖昧にする

- 効果測定を行わない

- 現場の成功事例を共有しない

生成AIは、導入しただけでは成果につながりません。運用設計、研修、ルール、改善サイクルをそろえて初めて、行政実務に定着します。

まとめ

自治体における生成AI活用は、業務効率化や住民サービス向上につながる可能性があります。文書作成、要約、企画整理、FAQ整備、広報文作成など、行政実務と相性のよい場面は少なくありません。

しかし、生成AIは万能ではありません。情報漏えい、ハルシネーション、著作権侵害、バイアス、説明責任の不明確化といったリスクがあります。

そのため、自治体が生成AIを導入する際には、次の4点が重要です。

- 入力してはいけない情報を明確にする

- 出力結果を人間が確認する仕組みをつくる

- 著作権・バイアス・倫理面を研修に含める

- 継続的な職員研修とガイドライン運用を行う

生成AI導入の本質は、ツールを使うことではありません。職員が安全に使いこなし、住民サービスの質を守りながら、行政の生産性を高めることです。

これからの自治体DXでは、生成AIを「導入するかどうか」ではなく、「どう管理し、どう育て、どう実務に定着させるか」が問われます。

JAICでは、自治体や公的機関における生成AI活用について、職員研修、ガイドライン整備、業務活用設計、リスク管理の観点から支援を行っています。生成AIを安全に、そして実務に役立つ形で活用するためには、技術と運用の両面から設計することが重要です。

コメント